Penjelajahan Web vs. Pengambilan Data Web: Perbedaan Essensial

Nikolai Smirnov

Software Development Lead

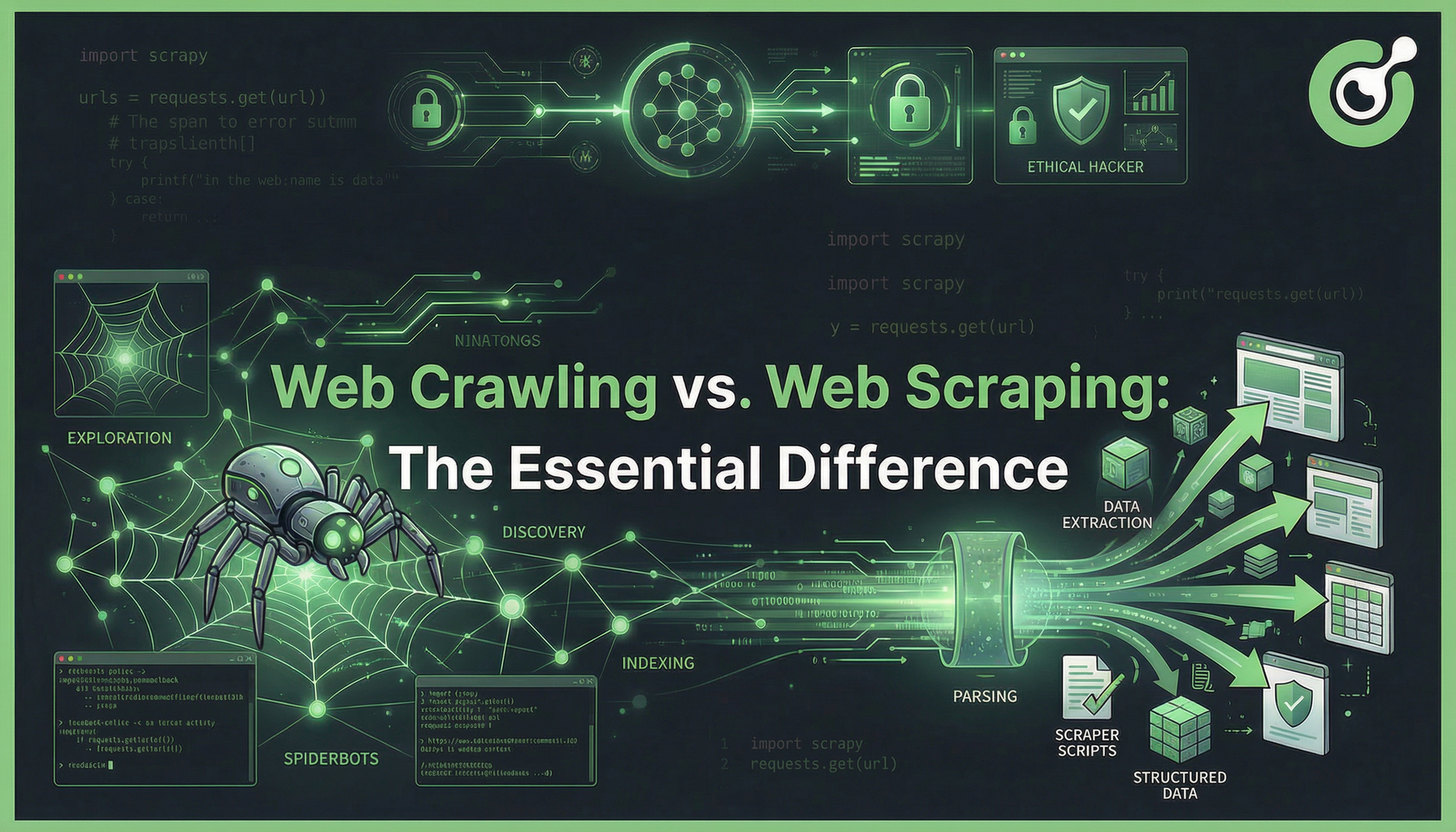

TL;DR: Web crawling adalah proses menemukan dan mengindeks halaman web dengan mengikuti tautan, terutama digunakan oleh mesin pencari dan audit situs. Web scraping adalah ekstraksi data spesifik dari halaman yang ditemukan, penting untuk penelitian pasar dan analisis data. Kedua proses ini, terutama web scraping, sering terganggu oleh kontrol akses canggih seperti AWS WAF. Tantangan ini dapat diatasi secara efektif menggunakan solusi khusus seperti CapSolver.

Pendahuluan

Dunia digital dibangun berdasarkan data, dan proses web crawling dan web scraping adalah mekanisme dasar untuk mengumpulkan informasi yang luas. Meskipun sering digunakan secara bergantian, keduanya mewakili dua tahap yang berbeda, tetapi saling melengkapi dalam pipeline pengadaan data. Memahami perbedaan antara web crawling dan web scraping sangat penting bagi siapa pun yang membangun aplikasi berbasis data, melakukan penelitian pasar, atau mengoptimalkan mesin pencari.

Panduan komprehensif ini ditujukan untuk ilmuwan data, spesialis SEO, dan pengembang. Kami akan menjelaskan dengan jelas setiap proses, menyoroti perbedaan intinya, menjelajahi 10 solusi terperinci di mana keduanya diterapkan, dan menunjukkan bagaimana alat seperti CapSolver dapat meningkatkan efisiensi dan menyelesaikan tantangan akses umum. Setelah selesai, Anda akan memiliki kerangka kerja yang kuat untuk menerapkan strategi pengumpulan data yang efisien dan sesuai aturan.

Web Crawling vs Web Scraping: Perbedaan Inti

Pada intinya, perbedaan antara web crawling dan web scraping terletak pada tujuan utamanya. Web crawling tentang penemuan dan pemetaan, sementara web scraping tentang ekstraksi dan struktur.

Sebuah crawler web, seperti Googlebot, secara sistematis menjelajahi seluruh web, mengikuti tautan hiperteks dari satu halaman ke halaman lainnya. Tujuannya adalah untuk membuat indeks komprehensif internet. Sebaliknya, web scraper menargetkan titik data spesifik—seperti harga produk, informasi kontak, atau teks artikel—dari kumpulan URL yang diketahui, mengubah HTML yang tidak terstruktur menjadi format data yang bersih dan dapat digunakan seperti CSV atau JSON.

Ringkasan Perbandingan: Crawling vs Scraping

| Fitur | Web Crawling | Web Scraping |

|---|---|---|

| Tujuan Utama | Penemuan, Indeks, Pemetaan Struktur Situs | Ekstraksi Data, Struktur, Analisis |

| Output | Daftar URL, peta situs, atau indeks halaman | Data yang terstruktur (JSON, CSV, catatan basis data) |

| Cakupan | Tingkat Situs atau Web (mengikuti semua tautan) | Tingkat Halaman (menargetkan elemen tertentu) |

| Analogi | Seorang pustakawan mengkatalog seluruh buku di perpustakaan | Seorang peneliti mengekstrak kutipan spesifik dari sebuah buku |

| Alat Kunci | Scrapy, Apache Nutch, Googlebot | BeautifulSoup, Puppeteer, Selenium, Skrip Kustom |

| Kasus Penggunaan Umum | Optimisasi Mesin Pencari (SEO), Audit Situs | Pemantauan Harga, Penghasilan Prospek, Penelitian Pasar |

Web Crawling: Mesin Penemuan

Web crawling adalah proses otomatis yang secara sistematis menjelajahi World Wide Web. Ini adalah langkah dasar untuk mesin pencari untuk menemukan konten baru dan diperbarui.

Tujuan dan Mekanisme

Tujuan utama dari web crawling adalah membuat peta internet atau situs tertentu. Sebuah crawler mulai dengan daftar URL awal, mengambil konten halaman tersebut, lalu menganalisis HTML untuk menemukan tautan hiperteks baru. Proses ini diulang secara rekursif, memperluas jangkauannya. Proses ini diatur oleh aturan yang ditentukan dalam file robots.txt, yang menentukan bagian mana dari situs yang diizinkan crawler akses.

Bagi profesional SEO, crawling sangat penting. Krawl yang sukses berarti halaman dapat diindeks dan diklasifikasikan. Menurut studi tentang pentingnya SEO, krawl yang sukses adalah langkah pertama kritis untuk mencapai visibilitas organik. ClickGuard mencatat bahwa jika halaman tidak dikrawl, itu tidak dapat diklasifikasikan.

Alat Kunci untuk Web Crawling

- Scrapy: Kerangka kerja crawling dan scraping web berbasis Python yang cepat dan tingkat tinggi. Cocok untuk proyek crawling skala besar dan kompleks.

- Apache Nutch: Crawler web open-source yang dapat digunakan untuk membangun mesin pencari skala besar.

- Crawlers Kustom: Dibangun menggunakan perpustakaan seperti

requestsdanBeautifulSoupdalam Python, sering untuk tugas kecil dan sangat kustomisasi.

Web Scraping: Seni Ekstraksi Data

Web scraping adalah teknik mengambil data spesifik dari situs web. Ini adalah proses yang lebih fokus yang terjadi setelah halaman ditemukan oleh crawler atau ketika URL sudah diketahui.

Tujuan dan Mekanisme

Tujuan dari web scraping adalah mengubah data yang dapat dibaca manusia, tidak terstruktur, di halaman web menjadi format yang dapat dibaca mesin, terstruktur. Ini melibatkan penggunaan selektor (seperti selektor CSS atau XPath) untuk menentukan elemen data yang tepat—seperti nama produk, harga, atau skor ulasan—lalu mengekstrak dan membersihkan teks tersebut.

Pasaran web scraping mengalami pertumbuhan signifikan. Pasar web scraping global diperkirakan mencapai USD 2,00 miliar pada 2030, didorong oleh permintaan yang meningkat untuk sumber data alternatif di bidang keuangan, e-commerce, dan intelijen pasar. Mordor Intelligence menyoroti ekspansi cepat ini.

Alat Kunci untuk Web Scraping

- BeautifulSoup: Perpustakaan Python untuk memproses dokumen HTML dan XML, sering digunakan bersama perpustakaan

requests. - Selenium/Puppeteer: Alat otomasi browser yang digunakan untuk mengambil konten dinamis (halaman yang dirender JavaScript) dengan mensimulasikan interaksi pengguna nyata.

- API Scraping Khusus: Layanan yang menangani infrastruktur, rotasi proxy, dan bypass anti-bot untuk pengguna.

10 Solusi dan Kasus Penggunaan Terperinci untuk Crawling dan Scraping

Menguasai kedua proses web crawling dan web scraping memungkinkan pembuatan solusi yang kuat dan berbasis data. Berikut adalah 10 aplikasi terperinci, menunjukkan sinergi antara penemuan dan ekstraksi.

1. Audit Situs SEO Komprehensif (Crawling)

Tujuan: Mengidentifikasi tautan rusak, rantai redirect, dan masalah struktur situs yang menghambat indeks mesin pencari.

Proses: Sebuah crawler mulai dari halaman beranda dan mengikuti setiap tautan internal. Ia mencatat kode status (200, 404, 301), judul halaman, dan kedalaman untuk setiap URL.

Nilai: Memastikan semua halaman penting dapat ditemukan oleh crawler mesin pencari, yang merupakan dasar untuk SEO yang baik.

2. Pemantauan Harga E-commerce Real-Time (Scraping)

Tujuan: Memantau harga kompetitor untuk ribuan produk untuk menyesuaikan strategi harga dinamis.

Proses: Sebuah scraper diberikan daftar URL produk yang diketahui. Ia menargetkan elemen HTML spesifik yang berisi harga dan mengekstrak nilai numeriknya.

Nilai: Memberikan keunggulan kompetitif dengan memungkinkan respons instan terhadap perubahan pasar.

3. Penghasilan Prospek dan Akuisisi Data Kontak (Scraping)

Tujuan: Menarik detail kontak (email, nomor telepon) dari direktori bisnis atau situs jaringan profesional.

Proses: Sebuah crawler terlebih dahulu menemukan halaman profil perusahaan yang relevan. Scraper kemudian mengekstrak pola teks spesifik yang sesuai dengan alamat email dan nomor telepon dari halaman tersebut.

Nilai: Menyuntikkan informasi kontak yang segar dan terarah ke pipeline penjualan dan pemasaran.

4. Indeks dan Peringkat Mesin Pencari (Crawling)

Tujuan: Fungsi inti dari mesin pencari besar seperti Google dan Bing.

Proses: Crawler yang besar dan terdistribusi terus-menerus menemukan konten baru. Halaman yang ditemukan kemudian diberikan ke indeks, yang memproses teks dan menyimpannya dalam basis data besar untuk akses cepat.

Nilai: Membuat kekayaan internet dapat dicari bagi miliaran pengguna.

5. Agregasi Konten dan Feed Berita (Crawling & Scraping)

Tujuan: Membuat platform terpusat yang menarik artikel dari sumber berita berbeda.

Proses: Sebuah crawler memantau sitemap dan halaman kategori situs berita target. Ketika URL artikel baru ditemukan, sebuah scraper mengekstrak judul artikel, teks tubuh, penulis, dan tanggal publikasi.

Nilai: Memangku pembaca berita yang dipersonalisasi dan platform analisis konten.

6. Penelitian Pasar dan Analisis Sentimen (Scraping)

Tujuan: Mengumpulkan ulasan dan komentar pelanggan dari forum, media sosial, dan situs e-commerce untuk menilai opini publik tentang produk.

Proses: Scraper menargetkan bagian ulasan halaman produk, mengekstrak teks dan peringkat bintang. Data ini kemudian dimasukkan ke model pemrosesan bahasa alami (NLP) untuk skoring sentimen.

Nilai: Memberikan wawasan yang dapat bertindak tentang kekuatan dan kelemahan produk langsung dari suara konsumen.

7. Deteksi Perubahan Situs Web (Crawling & Scraping)

Tujuan: Memantau sejumlah halaman tertentu untuk perubahan yang tidak sah, pembaruan regulasi, atau ketersediaan stok.

Proses: Sebuah crawler mengunjungi URL target secara terjadwal. Sebuah scraper mengekstrak hash konten inti halaman. Jika hash berubah, alarm diaktifkan.

Nilai: Penting untuk kepatuhan, intelijen kompetitif, dan pelacakan inventaris.

8. Penelitian Akademik dan Pemetaan Kutipan (Crawling)

Tujuan: Memetakan jaringan kutipan dalam bidang studi tertentu.

Proses: Sebuah crawler mulai dari sebuah kertas kunci dan mengekstrak semua referensi dan kertas yang mengutipnya. Ia mengikuti tautan ini untuk membangun grafik pengaruh akademik.

Nilai: Membantu peneliti mengidentifikasi penulis kunci dan tren yang muncul dalam domain mereka.

9. Migrasi Data dan Arsip (Scraping)

Tujuan: Menarik semua konten dari situs lama sebelum menonaktifkannya, atau mengarsipkan situs untuk tujuan sejarah.

Proses: Sebuah crawler mengidentifikasi semua URL di situs lama. Sebuah scraper secara sistematis mengekstrak konten HTML lengkap setiap halaman dan menyimpannya secara lokal.

Nilai: Memelihara data dan konten bernilai selama transisi platform.

10. Pelatihan Model Pembelajaran Mesin (Scraping)

Tujuan: Mendapatkan dataset besar dan beragam untuk melatih model AI, seperti pengenalan gambar atau model bahasa.

Proses: Scraper ditempatkan untuk mengumpulkan jutaan gambar dengan captionnya, atau sejumlah besar data teks dari berbagai sumber.

Nilai: Menyediakan bahan bakar yang diperlukan untuk mengembangkan dan menyempurnakan teknologi AI terkini.

Tantangan: Kontrol Akses Modern dan AWS WAF

Seiring meningkatnya nilai data web, situs web telah mengadopsi mekanisme keamanan dan filter lalu lintas yang semakin canggih. Ini termasuk pembatasan laju, pemeriksaan reputasi IP, dan verifikasi CAPTCHA, sering ditegakkan melalui Web Application Firewalls (WAF) seperti AWS WAF. Di bawah kontrol ini, crawling skala besar dan ekstraksi data selektif dapat ditandai sebagai perilaku tidak biasa, mengakibatkan permintaan yang diblokir atau alur data yang terganggu.

Ketika lalu lintas diduga otomatis, AWS WAF mungkin mengeluarkan tantangan CAPTCHA, menghentikan alur kerja hingga diselesaikan. Dalam skenario ini, solusi khusus menjadi penting untuk mempertahankan kelanjutan dan keandalan data.

CapSolver: Alat Esensial untuk Pengumpulan Data yang Tak Terputus

CapSolver adalah layanan bypass CAPTCHA dan anti-bot berbasis AI yang memastikan operasi crawling dan scraping web Anda tetap mulus dan efisien, bahkan melawan pertahanan terkuat seperti AWS WAF. Ia berfungsi sebagai lapisan kritis, menyelesaikan tantangan secara real-time sehingga crawler dan scraper Anda dapat berjalan tanpa gangguan.

CapSolver menawarkan solusi berbasis token dan pengenalan untuk AWS WAF, memungkinkan pengembang untuk mengintegrasikannya langsung ke kerangka kerja scraping Python atau Node.js yang ada.

Klaim Kode Bonus CapSolver Anda

Tingkatkan anggaran otomatisasi Anda secara instan!

Gunakan kode bonus CAPN saat menambahkan dana ke akun CapSolver Anda untuk mendapatkan bonus tambahan 5% pada setiap penambahan dana — tanpa batas.

Klaim sekarang di Dasbor CapSolver Anda

.

Mengintegrasikan CapSolver untuk Bypass AWS WAF

Untuk menunjukkan kekuatan CapSolver, berikut adalah cara Anda mengintegrasikannya untuk menyelesaikan tantangan AWS WAF menggunakan mode pengenalan dan mode token.

Solusi 1: Mode Pengenalan AWS WAF (CAPTCHA Berbasis Gambar)

Mode ini digunakan ketika WAF menampilkan tantangan visual (misalnya, "Pilih semua gambar yang berisi mobil").

Langkah Operasi Kode (Contoh Python):

- Ambil: Scraper Anda mendeteksi tantangan gambar AWS WAF dan menangkap gambar.

- Kirim: Kirim gambar ke API CapSolver menggunakan tipe tugas

AwsWafClassification. - Terima: AI CapSolver mengembalikan koordinat atau label objek yang benar.

- Selesaikan: Scraper Anda menggunakan koordinat untuk mensimulasikan klik yang benar di halaman tantangan.

Referensi Tugas CapSolver (Mode Pengenalan):

Untuk parameter API dan implementasi yang rinci, lihat dokumentasi resmi: CapSolver AWS WAF Classification

Solusi 2: Mode Token AWS WAF (Tidak Terlihat/Tantangan Halaman)

Mode ini digunakan ketika WAF memerlukan token valid untuk melanjutkan, sering setelah layar pemuatan singkat atau pemeriksaan tidak terlihat.

Langkah Operasi Kode (Contoh Python):

- Identifikasi: Scraper Anda mengidentifikasi parameter yang diperlukan dari halaman tantangan (misalnya,

host,iv,key,context). - Kirim: Kirim parameter ini ke API CapSolver menggunakan tipe tugas

AwsWaf. - Terima: CapSolver menyelesaikan tantangan dan mengembalikan token yang valid.

- Bypass: Scraper Anda menyisipkan token yang diterima ke header atau data formulir permintaan berikutnya untuk melewati WAF.

Referensi Tugas CapSolver (Mode Token):

Untuk parameter API dan implementasi yang rinci, lihat dokumentasi resmi: CapSolver AWS WAF Token

Kesimpulan dan Ajakan Bertindak

Perbedaan antara web crawling dan web scraping jelas: crawling adalah peta, dan scraping adalah harta karun. Keduanya tidak tergantikan untuk strategi data modern, baik Anda seorang profesional SEO yang memastikan keterjangkauan atau ilmuwan data yang membangun platform intelijen pasar.

Namun, penggunaan yang semakin meningkat dari sistem anti-bot canggih seperti AWS WAF berarti bahkan pipeline crawling dan scraping yang dirancang dengan baik bisa gagal. Untuk mempertahankan uptime tinggi dan akurasi data, Anda membutuhkan solusi yang andal.

CapSolver memberikan lapisan pertahanan esensial terhadap tantangan ini, memastikan alur data Anda tetap tidak terganggu. Berhenti membuang waktu untuk menyelesaikan CAPTCHA manual atau menghadapi pemblokiran IP.

Siap membangun pipeline data yang kuat dan tak terganggu?

- Mulai perjalanan Anda: Kunjungi situs web CapSolver untuk menjelajahi semua solusi anti-bot mereka.

- Mulai segera: Daftar untuk uji coba gratis Anda di Dashboard CapSolver.

Situs Resmi CapSolver

Dashboard CapSolver

Pertanyaan yang Sering Diajukan (FAQ)

Q1: Apakah web crawling atau web scraping ilegal?

Tidak, baik web crawling maupun web scraping tidak secara inheren ilegal. Ketentuan hukumnya tergantung pada apa yang Anda ambil dan bagaimana Anda melakukannya. Anda harus menghormati file robots.txt, hindari mengambil data pribadi atau yang dilindungi hak cipta, dan patuhi ketentuan layanan. Crawling yang berlebihan dan agresif yang merusak kinerja situs web bisa dianggap ilegal atau tidak etis.

Q2: Apakah saya bisa melakukan web scraping tanpa web crawling?

Ya, Anda bisa. Jika Anda sudah memiliki daftar URL tertentu (misalnya, daftar halaman produk dari database), Anda bisa melakukan web scraping langsung pada halaman-halaman tersebut tanpa perlu web crawling seluruh situs terlebih dahulu. Crawling hanya diperlukan untuk penemuan.

Q3: Bagaimana CapSolver membantu dengan web crawling dan web scraping?

CapSolver berperan penting dalam menyelesaikan tantangan akses yang mengganggu kedua alur kerja. Dalam crawling skala besar, volume permintaan yang tinggi mungkin memicu verifikasi CAPTCHA karena pembatasan kecepatan. Dalam scraping yang ditargetkan, satu kali percobaan ekstraksi mungkin memicu tantangan AWS WAF. CapSolver memproses verifikasi ini secara real-time, memungkinkan kelancaran kelanjutan fase penemuan (crawling) dan fase ekstraksi (scraping) tanpa gangguan.

Q4: Apa perbedaan utama antara scraper sederhana dan kerangka crawler yang lengkap seperti Scrapy?

Scraper sederhana (misalnya, menggunakan requests dan BeautifulSoup) biasanya adalah satu skrip yang dirancang untuk mengekstrak data dari satu halaman atau daftar URL kecil yang diketahui. Kerangka crawler yang lengkap seperti Scrapy dirancang untuk crawling web skala besar. Itu menangani penemuan tautan, penjadwalan permintaan, ulang, rotasi proxy, dan manajemen pipeline, membuatnya cocok untuk memetakan seluruh situs web.

Q5: Apakah crawling web hanya untuk mesin pencari?

Tidak. Meskipun mesin pencari adalah pengguna crawling web yang paling terkenal, crawling juga digunakan oleh alat SEO untuk audit situs, oleh peneliti akademik untuk memetakan jaringan kutipan, dan oleh pengumpul konten untuk menemukan artikel baru. Setiap tugas yang memerlukan penemuan sistematis tautan dan halaman memperoleh manfaat dari crawling web.

Lihat Lebih Banyak

web scrapingApr 22, 2026

Arsitektur Pengambilan Data Web Rust untuk Ekstraksi Data yang Dapat Diskalakan

Pelajari arsitektur pengambilan data web Rust yang dapat diskalakan dengan reqwest, scraper, pengambilan data asinkron, pengambilan data browser tanpa tampilan, rotasi proxy, dan penanganan CAPTCHA yang sesuai aturan.

web scrapingFeb 17, 2026

Cara menyelesaikan Captcha di Nanobot dengan CapSolver

Mengotomasi penyelesaian CAPTCHA dengan Nanobot dan CapSolver. Gunakan Playwright untuk menyelesaikan reCAPTCHA dan Cloudflare secara otomatis.